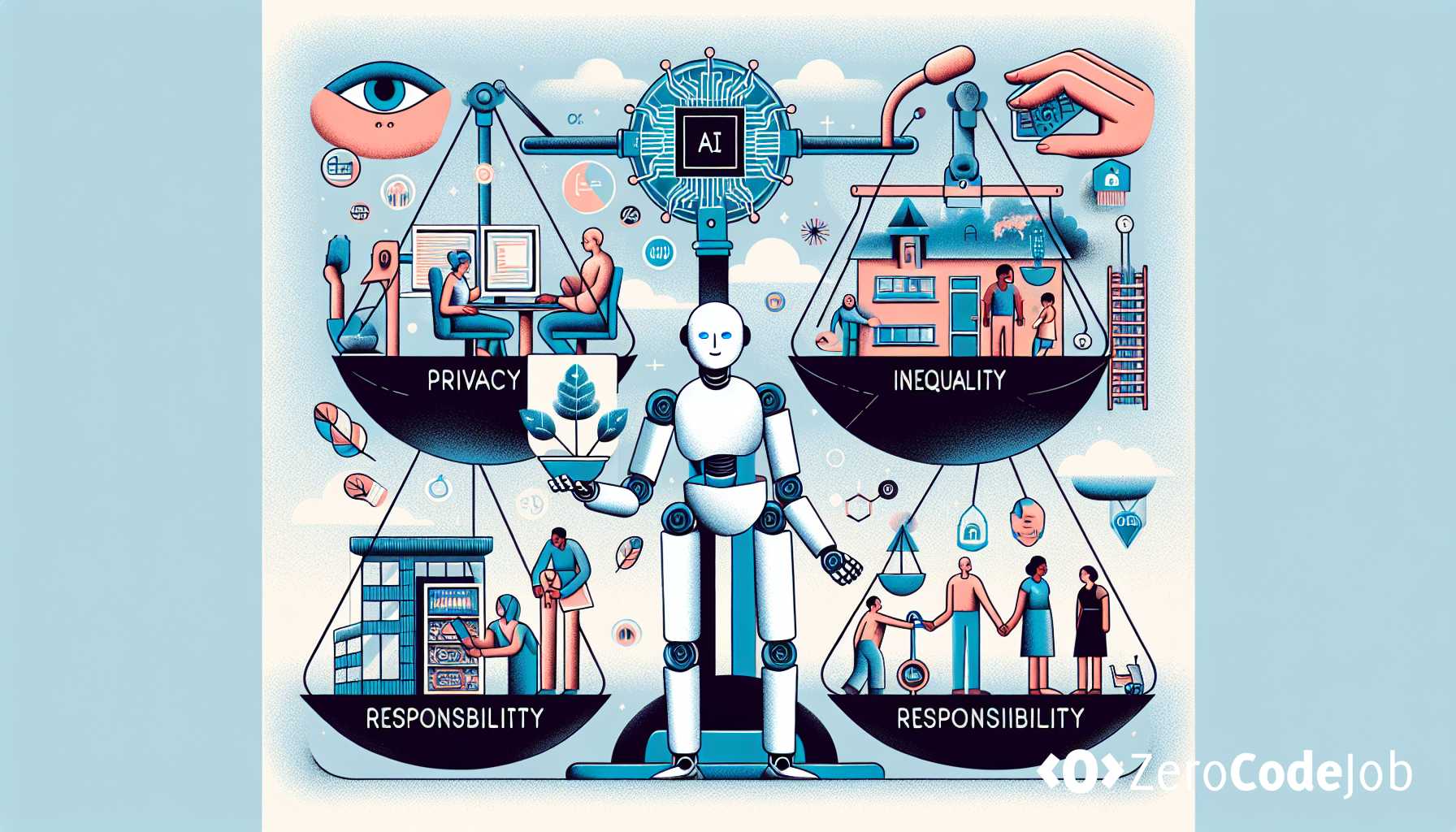

Etica dell'IA: privacy, disuguaglianze e responsabilità

Le sfide etiche legate all'intelligenza artificiale stanno diventando sempre più centrali nel dibattito pubblico. Recentemente, diversi esperti hanno sollevato preoccupazioni riguardo al possibile impatto negativo che l'IA potrebbe avere sulla società e sull'umanità nel suo complesso.

Una delle principali preoccupazioni riguarda l'etica della privacy e della sicurezza dei dati. Con l'aumento dell'uso dell'IA in settori come la sorveglianza e la raccolta di dati personali, c'è il timore che le informazioni sensibili possano essere utilizzate in modo improprio o violato, mettendo a rischio la privacy degli individui.

Inoltre, c'è il rischio che l'IA possa amplificare le disuguaglianze esistenti nella società. Ad esempio, se i sistemi di intelligenza artificiale vengono addestrati su dati parziali o discriminatori, potrebbero perpetuare e addirittura accentuare pregiudizi e disparità già presenti.

Allo stesso tempo, sorgono interrogativi sulla responsabilità e l'accountability nei confronti delle decisioni prese dagli algoritmi. Chi è responsabile in caso di errori o danni causati da un sistema di intelligenza artificiale? Come garantire una governance adeguata e trasparente per l'utilizzo responsabile dell'IA?

Queste e altre questioni etiche legate all'intelligenza artificiale richiedono un'attenzione sempre maggiore da parte dei governi, delle aziende e della società nel suo insieme, al fine di sviluppare regolamentazioni e linee guida che possano garantire un utilizzo etico e responsabile di questa tecnologia in rapida evoluzione.